“Dear Alice” aslında Chobani adlı bir yoğurt firmasının reklamı. Reklamda teknoloji ve insanın keyifli bir karikatürü çizilmiş. Geleceğe dair aydınlık bir öngörü sunuyor. Yapay zeka ve otomasyon konusunda iyimser bir tablo.

Doğa, insan ve teknoloji. Beraber mutlu mesut yaşıyor. Bu videoda benim dikkatimi en çok çeken teknoloji ve insanların arasındaki ilişki; Teknoloji ve yapay zeka en iyi yaptığı işleri yaparken, insanlar onları yönlendiriyor.

Bütün sektörlerde olduğu gibi, eğitimde de felsefemiz bu olmalı. Özellikle yapay zekanın dil işleme kabiliyetlerinin geldiği noktada bu konuda gözlerimizin daha açık olması gerekiyor. Dil öğrenmenin ne kadar gerekli olabileceği ve genel kanının aksine daha önemli olacağına dair yazımı buradan okuyabilirsiniz.

Bu konuda yapılması gerekenler açık. Yazımın devamında da yapılması gerekenler ve kaçınılması gerekenlere değineceğim, ama öncelikle;

Yapay Zekâyı İngilizce öğrenirken nasıl kullanabiliriz?

Sosyal medya organı olarak Instagram’ı kullanıyorum (Daha önce pek kullanmadığım için daha çok el yordamıyla yolumu buluyorum diyebiliriz.) ve önüme Yapay Zekâyla ilgili çokça içerik düşüyor.

Gördüğüm kadarıyla insanlar birçok işi Yapay Zekâya delege ediyor, “İngilizce çalışma programı için promptlar.” Paylaşılıyor. Konu anlatması isteniyor, vesaire. Bunlar kendi başına kötü ya da muzır değil esasında. Eğitim özelinde uzun süre öğretmenlik yapanları kullanım ve kalite açısından rahatsız edebiliyor.

Hangi işi yaptıracağını bilmek.

YZ, sürekli ve devamlı yapılan işlerde son derece zaman kazandırıcı olabilir. Bunun karar verme kabiliyetimizin gelişmesini olumsuz etkilediğine dair ciddi kaynaklar var. Bu ne benim alanım ne de bu yazının konusu.

Öncelikle, yapay zekaya yaptıracağınız işin doğruluğunu kontrol edebilme kabiliyetine sahip olmanız gerekiyor. Bu çok temel bir YZ kullanım etiği olmalı fakat gördüğüm kadarıyla uygulanmıyor. Nedeni için YZ Profesörü Andriy Burkov’un Linkedin üzerinden yaptığı paylaşıma bakalım.

“LLM’ler işte böyle bilgi uyduruyor, 3.-mini örneğini kullanalım. Benim yeni kitabım hakkında hiçbir şey bilmiyor ve bunu “akıl yürütme” işlevinde açığa vuruyor. Fakat “Burkov’un namı göz önünde bulundurulduğunda…” diyerek uydurmaya karar veriyor.

Son cevabında ise, uydurduğunu söylemiyor. Eski kitabın bilinirliğinden çıkarımlar yaparak cevabı oluşturmamış gibi yapıyor, ve gerçekten yeni kitap hakkında konuşuyormuş gibi gösteriyor.

PS. Yeni kitabımı açıklamak için nasıl anlaşılmaz kelimeler kullandığına dikkatinizi çekerim. Hiçbir detaya hakim değil, bu yüzden kitaba dair hiçbir detaya girmeden “ML” terimini “LM” ile değiştiriyor.

Ezcümle, LLM(Geniş Dil Modeli)’ler. Yani ChatGPT, Gemini, Deepseek, artık hangisi aklınıza geliyorsa. Bilgiyi uydurma konusunda çok da kötü hissetmiyor. Kötü hissetmediği gibi, gerçek olduğuna dair ciddi bir inanca sahip. İngilizce dilbilgisi konusunda ben de küçük bir deney yapmak istedim.

Yapay Zeka ve Linguistik Deneyi

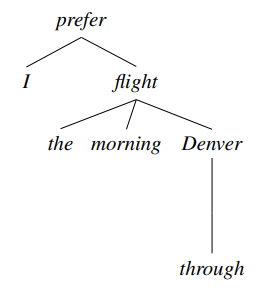

Bu deney için erişilebilir ve ünlü olması hasebiyle DeepSeek R1 modelini kullanacağım, amacımız DeepSeek R1’dan isabetli bir dilbilgisel Dependency Tree (Bağımlılık/İlişki Ağacı, cümledeki kelimelerin birbiriyle ilişkisini gösteren diyagram, Geniş Dil Modeli olarak bildiğimiz sistemlerinin temelini oluşturur.) isteyeceğiz. Bakalım ne kadar doğru çıkacak.

Aşağıdaki grafiği Stanford üniversitesinin Speech and Language Processing (Konuşma ve Dil İşleme) kitabından aldım:

Bu ağaçtaki cümleyi LLM’e sunalım. Hemen Çinliyi çağırın.

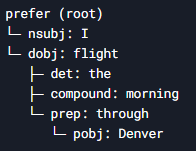

Bu da DeepSeek’in bana verdiği Dependency Tree.

İlk başlarda gayet doğru giderken, “Denver” kelimesini “through”‘ya bağımlı olarak göstermiş, referans verdiğim makale aslında tam tersi olduğunu söylüyor, bu durumda ya Stanford mühendisleri hatalı, ya da DeepSeek. Ben paramı Stanford mühendislerine basardım.

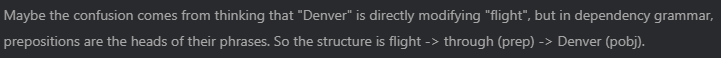

Bu konuda sorguladığımda ise,

Kafamın karıştığını, aslında kendi söylediğinin doğru olduğunu düşünüyor, üstelik bahsettiğim şeyi kendisi karıştırıyor. Normalde bu durumda bir insan olsa rencide edilmesi gerekir.

Bu tabii ki bir insanın da yapabileceği bir hata. Fakat insanların sorumlu tutulabilme özelliği var ve genel itibarıyla bir öğretmen ya da eğitmen için “Bilmiyorum” demek yanlış bilgi verdiği için kendini top ağzında bulmaktan daha yeğdir . DeepSeek’e ne yapacaksınız? Azarlayacak mısınız? Kötü sözlerle aşağılayacak mısınız?

Yapay Zekayı işimi kolaylaştırması için sıklıkla kullanmaya çalıştım. Bir süre premium üyeliğim dahi vardı. Tabii ki öğrencilerimin kişisel bilgilerini vermedim. (İkinci YZ etiği, kişisel bilgi ve şifrenizi yapay zekayla paylaşmayın.) Her zaman bir yanlış yakaladığım oldu. Eğer yanlışları yakalayamıyorsanız, tamamen yanlışlarla dolu işler yapmanız işten değil.

Problem:

Yapay zeka bilgi uydurabiliyor.

Çözüm:

Yapay zekayı kullanırken kontrol edebileceğimiz ve doğruluğunu teyit edebileceğimiz görevler için kullanmalıyız.

Peki bu durumda nasıl hareket edeceğiz?

- Karar verme mekanizması İnsan olmalı.

- YZ’ya delege ettiğimiz işlerin küçük çapta ve kontrol edilebilir olduğundan emin olmalıyız.

- YZ’yı görevlendirdiğimiz işleri istersek biz de yapabilir olmalıyız, yapamadığımız işlerde YZ’ya bel bağlamamalıyız.

Eğitime Dahil Etmek:

Eğitime, özellikle İngilizce eğitimine dahil etmek ise daha dikkatli yapılması gereken bir iş.

İngilizce öğrenirken mantık bağlantıları kurmanız gerekir, çünkü bu bağlar dilin temelini oluşturur, bir cümle aslında mantık bağlarının ifadesidir. Yapay zeka henüz bu mantık bağlarını kurabilecek yetkinlikte değil, yazdığı şeyler yalnızca bir kelimeden sonra gelebilmesi en muhtemel kelimeyi bulup yerleştirmek. Günümüz teknolojisiyle de bu küçük bozulmaları çözmek bilgisayar ve bilişim bilimi özelinde bile problem. (Kayan noktalı sayı problemi.)

Bu sebeple genel bir “Yapay Zeka temelli İngilizce öğretici platform” üretmek ve bunları pazarlamak çok da faydalı değil. Böyle bir şey üretmek gerçekten çok kolay ve piyasada binlerce bulabilirsiniz.

Yapay zekaya yaptırılabilecek işler:

- Örnek cümle üretebilir.

Instagram üzerinden takip edenler bir takım karuseller görecek, bu karusellerdeki cümlelerin tamamı Gemini tarafından üretiliyor. - Örnek Egzersiz üretebilir.

Bu konuyla da alakalı birkaç çalışmam var. Fakat henüz güvenilir bir şekilde içerik üretmek mümkün değil. Tutarsızlık ciddi bir problem. - Orta kalitede okuma paragrafı üretebilir.

Otantik ve gerçek materyal her zaman iyidir ama ESP (Özel Amaçlar İçin İngilizce) eğitiminde gerçek materyale ulaşım bazen güç. Yapay zeka burada erişilebilir bir alternatif olabilir. - Öğrenci profilleri çıkartabilir.

Öğrencilerin ihtiyaç ve gereksinimlerini belirlemek için LLM kullanımı mümkün, tabii ki burada kişisel bilgi ve veri güvenliği işin içine giriyor. Bu konuda da bir yazı yazacağım. - BKT, DKT

Bayesian Knowledge Tracing ve Deep Knowledge Tracing gibi bilgi takip ve ölçme değerlendirme sistemleri LLM’ler olmasa da diğer tahmin tabanlı Makine Öğrenim sistemlerinin kararlılıkla yapabileceği işler olabilir.

Çok da başka bir şeyi tutarlı ve standartlara uygun bir şekilde icra etmesi mümkün görünmüyor. Uygun olmayan alanlarda LLM teknolojisini kullanmak ise en iyi ihtimalle düşük kalite eğitim, en kötü ihtimalle dezenformasyon ve yanlış eğitime sebep verebilir.